Especialistas alertam para vazamento de dados na era de IA

Especialistas alertam para vazamento de dados na era de IA

Planos estratégicos com base em políticas de utilização e soluções tecnológicas podem prevenir riscos e danos

Especialistas alertam para vazamento de dados na era de IA

Planos estratégicos com base em políticas de utilização e soluções tecnológicas podem prevenir riscos e danos

Em meio à crescente revolução digital, as ocorrências de vazamentos de dados estão se tornando cada vez mais frequentes, especialmente por conta dos avanços e do uso inadvertido das ferramentas de inteligência artificial (IA). A situação tem colocado a cibersegurança no centro das discussões, a fim de evitar prejuízos financeiros e danos reputacionais às empresas. Especialistas apontam a adoção de uma rede de práticas, que envolvem políticas de utilização e a aplicação de soluções tecnológicas robustas, como alternativas para mitigar estes riscos.

O especialista em tecnologia, Guilherme Belinelo, CTO da dataRain ressalta que o investimento em um plano de prevenção pode evitar danos irreparáveis. “Os vazamentos de dados não apenas comprometem a confiança dos clientes e resultam em possíveis multas e processos legais devido à violação de privacidade, mas também podem levar a interrupções nos serviços enquanto são realizadas investigações e medidas corretivas. Além disso, a longo prazo, os dados vazados podem ser explorados por atores maliciosos para futuros ataques e roubo de identidade”.

De acordo com o especialista, os planos devem conter tanto políticas de utilização, que definem regras e diretrizes claras sobre como os dados devem ser acessados, armazenados, compartilhados e descartados, quanto soluções tecnológicas, que incluem medidas de segurança, como criptografia, firewalls, sistemas de detecção de intrusões e programas antivírus, que ajudam a proteger os dados contra acessos não autorizados e vazamentos acidentais. “É importante saber que além das ferramentas de cibersegurança, é fundamental que haja um treinamento adequado dos funcionários sobre os riscos de segurança cibernética”, diz.

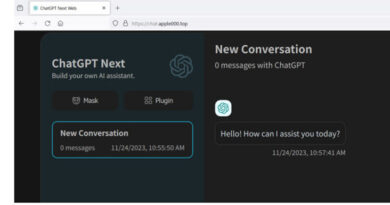

E isso inclui o uso consciente de ferramentas de IA, como o ChatGPT. “Implementar políticas claras sobre o uso de ferramentas de IA apresenta desafios significativos para as empresas. A imprecisão das respostas geradas por essas ferramentas e a dificuldade em verificar a fonte das informações levantam questões sobre confiabilidade e propriedade intelectual. É essencial encontrar um equilíbrio entre inovação e segurança cibernética, especialmente ao lidar com o uso de ferramentas de IA por funcionários”, complementa.

Futuro – A questão é ainda tema de discussões jurídicas, implicações regulatórias e de conformidade, como aponta Leonardo Baiardi, líder da equipe de segurança da dataRain. “É crucial que sejam estabelecidos padrões para garantir a proteção dos dados. A criação do Comitê Nacional de Cibersegurança visa abordar essas questões e promover discussões entre os poderes Executivo, Legislativo e Judiciário”.

Já no campo tecnológico, ironicamente, a própria IA pode ser um caminho nos avanços contra o vazamento de dados. “Um número cada vez maior de sistemas de segurança está aproveitando modelos de IA para interpretar e entender comportamentos e assinaturas de ataques. Dessa forma, podem se antecipar na prevenção e mitigação deles. Com uso de IA, a enxurrada de informações geradas por logs de aplicações, equipamentos de rede e sensores de monitoramento, pode ser analisada em tempo real, algo que não é possível sem uso de algum nível de Machine Learning”, diz Belinelo.

Para Baiardi, isso permite que equipes de segurança que monitoram infraestruturas de TI ativamente, conhecidas com SOC (Security Operation Center), usufruam dessas tecnologias integradas às soluções de segurança (como SIEM, NDR, IDS/IPS) para reduzir a quantidade de falsos-positivos, desafogando as equipes. “Assim, o tempo que seria perdido analisando quantidades massivas de logs pode ser usado de forma mais eficiente”, finaliza.